HDFS.

文章目录

- 1️⃣、HDFS的概述

- 1.1、HDFS产出背景及定义

- 1.2、HDFS优缺点

- 1.3、HDFS组成架构

- 1.4、HDFS文件块大小(面试重点)

- 2️⃣、HDFS的Shell操作

- 2.1、基本语法

- 2.2、命令大全

- 2.3、常用命令实操

- **上传**

- **下载**

- **其他**

- 3️⃣、HDFS的读写流程

- 3.1HDFS写数据流程

- 3.2、 HDFS读数据流程

- 4️⃣、NameNode和SecondaryNameNode

- 4.1、工作机制

- 4.2、Fsimage和Edits解析

- 4.3、CheckPoint时间设置

- 5️⃣、DataNode

- 5.1、工作机制

- 5.2、 数据完整性

- 5.3、 掉线时限参数设置

1️⃣、HDFS的概述

1.1、HDFS产出背景及定义

1)HDFS产生背景

随着数据量越来越大,在一个操作系统存不下所有的数据,那么就分配到更多的操作系统管理的磁盘中,但是不方便管理和维护,==迫切需要一种系统来管理多台机器上的文件,==这就是分布式文件管理系统。HDFS只是分布式文件管理系统中的一种。

2)HDFS定义

HDFS(Hadoop Distributed File System),它是一个文件系统,用于存储文件,通过目录树来定位文件;其次,它是分布式的,由很多服务器联合起来实现其功能,集群中的服务器有各自的角色。

==HDFS的使用场景:适合一次写入,多次读出的场景。==一个文件经过创建、写入和关闭之后就不需要改变。

1.2、HDFS优缺点

优点:

缺点:

1.3、HDFS组成架构

1.4、HDFS文件块大小(面试重点)

为什么块的大小不能设置太小,也不能设置太大?

- HDFS的块设置==太小,会增加寻址时间,==程序一直在找块的开始位置;

- 如果块设置的==太大,从磁盘传输数据的时间会明显大于定位这个块开始位置所需的时间。==导致程序在处理这块数据时,会非常慢。

- 总结:HDFS块的大小设置主要取决于磁盘传输速率。

2️⃣、HDFS的Shell操作

2.1、基本语法

hadoop fs 具体命令 OR hdfs dfs 具体命令

两个是完全相同的。

2.2、命令大全

[zsong@hadoop2 ~]$ hdfs dfs

Usage: hadoop fs [generic options][-appendToFile ... ][-cat [-ignoreCrc] ...][-checksum ...][-chgrp [-R] GROUP PATH...][-chmod [-R] PATH...][-chown [-R] [OWNER][:[GROUP]] PATH...][-copyFromLocal [-f] [-p] [-l] [-d] [-t ] ... ][-copyToLocal [-f] [-p] [-ignoreCrc] [-crc] ... ][-count [-q] [-h] [-v] [-t []] [-u] [-x] [-e] ...][-cp [-f] [-p | -p[topax]] [-d] ... ][-createSnapshot []][-deleteSnapshot ][-df [-h] [ ...]][-du [-s] [-h] [-v] [-x] ...][-expunge][-find ... ...][-get [-f] [-p] [-ignoreCrc] [-crc] ... ][-getfacl [-R] ][-getfattr [-R] {-n name | -d} [-e en] ][-getmerge [-nl] [-skip-empty-file] ][-head ][-help [cmd ...]][-ls [-C] [-d] [-h] [-q] [-R] [-t] [-S] [-r] [-u] [-e] [ ...]][-mkdir [-p] ...][-moveFromLocal ... ][-moveToLocal ][-mv ... ][-put [-f] [-p] [-l] [-d] ... ][-renameSnapshot ][-rm [-f] [-r|-R] [-skipTrash] [-safely] ...][-rmdir [--ignore-fail-on-non-empty] ...][-setfacl [-R] [{-b|-k} {-m|-x } ]|[--set ]][-setfattr {-n name [-v value] | -x name} ][-setrep [-R] [-w] ...][-stat [format] ...][-tail [-f] [-s ] ][-test -[defsz] ][-text [-ignoreCrc] ...][-touch [-a] [-m] [-t TIMESTAMP ] [-c] ...][-touchz ...][-truncate [-w] ...][-usage [cmd ...]] 2.3、常用命令实操

😄先启动Hadoop集群

[zsong@hadoop2 ~]$ start-dfs.sh

[zsong@hadoop2 ~]$ start-yearn.sh

😄-help:输出这个命令参数

[zsong@hadoop2 ~]$ hdfs dfs -help mkdir

-mkdir [-p] ... :Create a directory in specified location.-p Do not fail if the directory already exists

😄创建test文件夹

[zsong@hadoop2 ~]$ hdfs dfs -mkdir /test

上传

-moveFromLocal:从本地剪切粘贴到HDFS

[zsong@hadoop2 ~]$ ll

总用量 0

-rw-rw-r--. 1 zsong zsong 0 3月 12 14:50 a.txt

drwxrwxr-x. 2 zsong zsong 52 3月 12 15:02 bin

[zsong@hadoop2 ~]$ vim a.txt

[zsong@hadoop2 ~]$ hdfs dfs -moveFromLocal ./a.txt /test

2023-03-12 22:35:15,038 INFO sasl.SaslDataTransferClient: SASL encryption trust check: localHostTrusted = false, remoteHostTrusted = false

[zsong@hadoop2 ~]$ ll

总用量 0

drwxrwxr-x. 2 zsong zsong 52 3月 12 15:02 bin

-copyFromLocal:从本地文件系统中拷贝文件到HDFS路径去

[zsong@hadoop2 ~]$ hadoop fs -copyFromLocal nihao.txt /test

-put:等同于copyFromLocal,生产环境更习惯用put

[zsong@hadoop2 ~]$ hadoop fs -put demo.txt /test

-appendToFile:追加一个文件到已经存在的文件末尾

[zsong@hadoop2 hadoop]$ hdfs dfs -appendToFile demo.txt /test/a.txt

下载

-copyToLocal:从HDFS拷贝到本地

[zsong@hadoop2 hadoop]$ hdfs dfs -copyToLocal /test/a.txt ./

-get:等同于copyToLocal,生产环境更习惯用get

[zsong@hadoop2 hadoop]$ hdfs dfs -get /test/a.txt ./

其他

-ls: 显示目录信息

[zsong@hadoop2 hadoop]$ hdfs dfs -ls /

Found 4 items

drwxr-xr-x - zsong supergroup 0 2023-03-11 08:33 /input

drwxr-xr-x - zsong supergroup 0 2023-03-12 22:35 /test

drwxrwx--- - zsong supergroup 0 2023-03-11 13:00 /tmp

drwxr-xr-x - zsong supergroup 0 2023-03-10 23:41 /wcinput

-cat:显示文件内容

[zsong@hadoop2 hadoop]$ hdfs dfs -cat /test/a.txt

-chgrp、-chmod、-chown:Linux文件系统中的用法一样,修改文件所属权限

[zsong@hadoop2 hadoop]$ hadoop fs -chmod 666 /test/a.txt[zsong@hadoop2 hadoop]$ hadoop fs -chown zsong:zsong /test/a.txt

-

-mkdir:创建路径

-

-cp:从HDFS的一个路径拷贝到HDFS的另一个路径

[zsong@hadoop2 hadoop]$ hdfs dfs -cp /test/a.txt /

-

-mv:在HDFS目录中移动文件

-

-tail:显示一个文件的末尾1kb的数据

[zsong@hadoop2 hadoop]$ hdfs dfs -tail /a.txt

-

-rm:删除文件或文件夹

-

-rm -r:递归删除目录及目录里面内容

-

-du统计文件夹的大小信息

[zsong@hadoop2 hadoop]$ hdfs dfs -du -s -h /a.txt

[zsong@hadoop2 hadoop]$ hdfs dfs -du -h /a.txt

[zsong@hadoop2 hadoop]$ hdfs dfs -du /a.txt

- -setrep:设置HDFS中文件的副本数量

[zsong@hadoop2 hadoop]$ hdfs dfs -setrep 10 /a.txt

这里设置的副本数只是记录在NameNode的元数据中,是否真的会有这么多副本,还得看DataNode的数量。因为目前只有3台设备,最多也就3个副本,只有节点数的增加到10台时,副本数才能达到10。

3️⃣、HDFS的读写流程

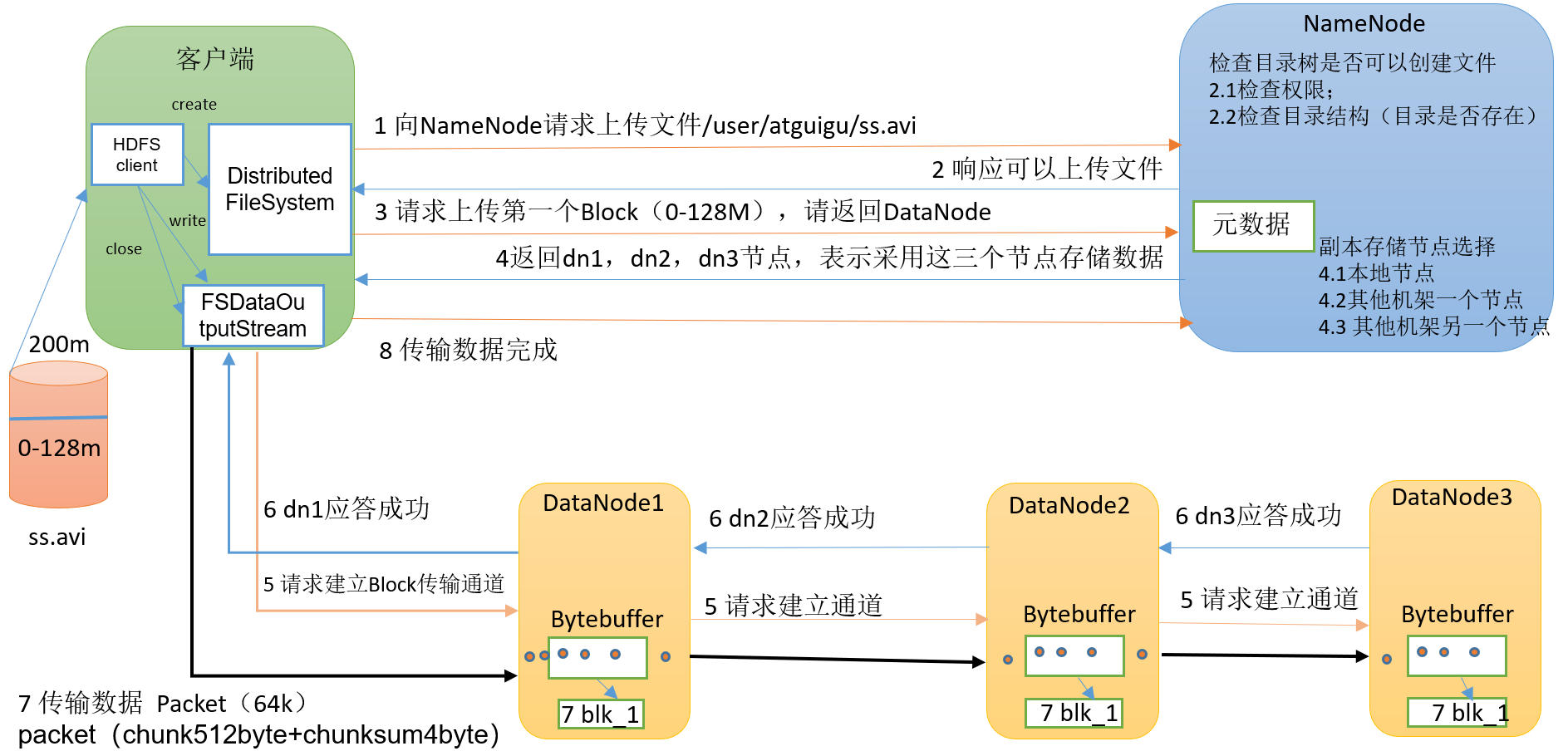

3.1HDFS写数据流程

(1)客户端通过Distributed FileSystem模块向NameNode请求上传文件,NameNode检查目标文件是否已存在,父目录是否存在。

(2)NameNode返回是否可以上传。

(3)客户端请求第一个 Block上传到哪几个DataNode服务器上。

(4)NameNode返回3个DataNode节点,分别为dn1、dn2、dn3。

(5)客户端通过FSDataOutputStream模块请求dn1上传数据,dn1收到请求会继续调用dn2,然后dn2调用dn3,将这个通信管道建立完成。

(6)dn1、dn2、dn3逐级应答客户端。

(7)客户端开始往dn1上传第一个Block(先从磁盘读取数据放到一个本地内存缓存),以Packet为单位,dn1收到一个Packet就会传给dn2,dn2传给dn3;dn1每传一个packet会放入一个应答队列等待应答。

(8)当一个Block传输完成之后,客户端再次请求NameNode上传第二个Block的服务器。(重复执行3-7步)。3.2、 HDFS读数据流程

(1)客户端通过DistributedFileSystem向NameNode请求下载文件,NameNode通过查询元数据,找到文件块所在的DataNode地址。

(2)挑选一台DataNode(就近原则,然后随机)服务器,请求读取数据。

(3)DataNode开始传输数据给客户端(从磁盘里面读取数据输入流,以Packet为单位来做校验)。

(4)客户端以Packet为单位接收,先在本地缓存,然后写入目标文件。4️⃣、NameNode和SecondaryNameNode

4.1、工作机制

思考:NameNode中的元数据是存储在哪里的?

- 首先,我们做个假设,如果存储在NameNode节点的磁盘中,因为经常需要进行随机访问,还有响应客户请求,必然是效率过低。因此,元数据需要存放在内存中。但如果只存在内存中,一旦断电,元数据丢失,整个集群就无法工作了。因此产生在磁盘中备份元数据的FsImage。

- 这样又会带来新的问题,当在内存中的元数据更新时,如果同时更新FsImage,就会导致效率过低,但如果不更新,就会发生一致性问题,一旦NameNode节点断电,就会产生数据丢失。==因此,引入Edits文件(只进行追加操作,效率很高)。每当元数据有更新或者添加元数据时,修改内存中的元数据并追加到Edits中。==这样,一旦NameNode节点断电,可以通过FsImage和Edits的合并,合成元数据。

- 但是,如果长时间添加数据到Edits中,会导致该文件数据过大,效率降低,而且一旦断电,恢复元数据需要的时间过长。因此,需要定期进行FsImage和Edits的合并,如果这个操作由NameNode节点完成,又会效率过低。因此,引入一个新的节点SecondaryNamenode,专门用于FsImage和Edits的合并。

1)第一阶段:NameNode启动

(1)第一次启动NameNode格式化后,创建Fsimage和Edits文件。如果不是第一次启动,直接加载编辑日志和镜像文件到内存。

(2)客户端对元数据进行增删改的请求。

(3)NameNode记录操作日志,更新滚动日志。

(4)NameNode在内存中对元数据进行增删改。

2)第二阶段:Secondary NameNode工作

(1)Secondary NameNode询问NameNode是否需要CheckPoint。直接带回NameNode是否检查结果。

(2)Secondary NameNode请求执行CheckPoint。

(3)NameNode滚动正在写的Edits日志。

(4)将滚动前的编辑日志和镜像文件拷贝到Secondary NameNode。

(5)Secondary NameNode加载编辑日志和镜像文件到内存,并合并。

(6)生成新的镜像文件fsimage.chkpoint。

(7)拷贝fsimage.chkpoint到NameNode。

(8)NameNode将fsimage.chkpoint重新命名成fsimage。

4.2、Fsimage和Edits解析

NameNode被格式化,之后,将在/opt/module/hadoop3.l.3/data/tmp/dfs/name/current目录中产生如下文件fsimage0000000000000000000fsimage0000000000000000000.md5seen txidVERSION

(1)Fsimage文件:HDFS文件系统元数据的一个永久性的检查点,其中包含HDFS文件系统的所有目录和文件inode的序列化信息。(2)Edits文件:存放HDFS文件系统的所有更新操作的路径,文件系统客户端执行的所有写操作首先会被记录到Edits文件中。(3)seen_txid文件保存的是一个数字,就是最后一个edits的数字(4)每次NameNode启动的时候都会将Fsimage文件读入内存,加载Edits里面的更新操作,保证内存中的元数据信息是最新的、同步的,可以看成NameNode启动的时候就将Fsimage和Edits文件进行了合并。

1)oiv查看Fsimage文件

hdfs oiv -p 文件类型 -i镜像文件 -o 转换后文件输出路径

[zsong@hadoop2 current]$ pwd

/opt/module/hadoop/data/dfs/name/current[zsong@hadoop2 current]$ hdfs oiv -p XML -i fsimage_0000000000000000025 -o /opt/module/hadoop/fsimage.xml[zsong@hadoop2 current]$ cat /opt/module/hadoop/fsimage.xml2)oev查看Edits文件

hdfs oev -p 文件类型 -i编辑日志 -o 转换后文件输出路径

[zsong@hadoop2 current]$ hdfs oev -p XML -i edits_0000000000000000012-0000000000000000013 -o /opt/module/hadoop/edits.xml[zsong@hadoop2 current]$ cat /opt/module/hadoop/edits.xml4.3、CheckPoint时间设置

1)通常情况下,SecondaryNameNode每隔一小时执行一次。

[hdfs-default.xml]

dfs.namenode.checkpoint.period 3600s

2)一分钟检查一次操作次数,当操作次数达到1百万时,SecondaryNameNode执行一次。

dfs.namenode.checkpoint.txns 1000000 操作动作次数

dfs.namenode.checkpoint.check.period 60s

1分钟检查一次操作次数

5️⃣、DataNode

5.1、工作机制

(1)一个数据块在DataNode上以文件形式存储在磁盘上,包括两个文件,一个是数据本身,一个是元数据包括数据块的长度,块数据的校验和,以及时间戳。

(2)DataNode启动后向NameNode注册,通过后,周期性(6小时)的向NameNode上报所有的块信息。

DN向NN汇报当前解读信息的时间间隔,默认6小时;

dfs.blockreport.intervalMsec 21600000 Determines block reporting interval in milliseconds.

DN扫描自己节点块信息列表的时间,默认6小时

dfs.datanode.directoryscan.interval 21600s Interval in seconds for Datanode to scan data directories and reconcile the difference between blocks in memory and on the disk.Support multiple time unit suffix(case insensitive), as describedin dfs.heartbeat.interval.

(3)心跳是每3秒一次,心跳返回结果带有NameNode给该DataNode的命令如复制块数据到另一台机器,或删除某个数据块。如果超过10分钟没有收到某个DataNode的心跳,则认为该节点不可用。

(4)集群运行中可以安全加入和退出一些机器。

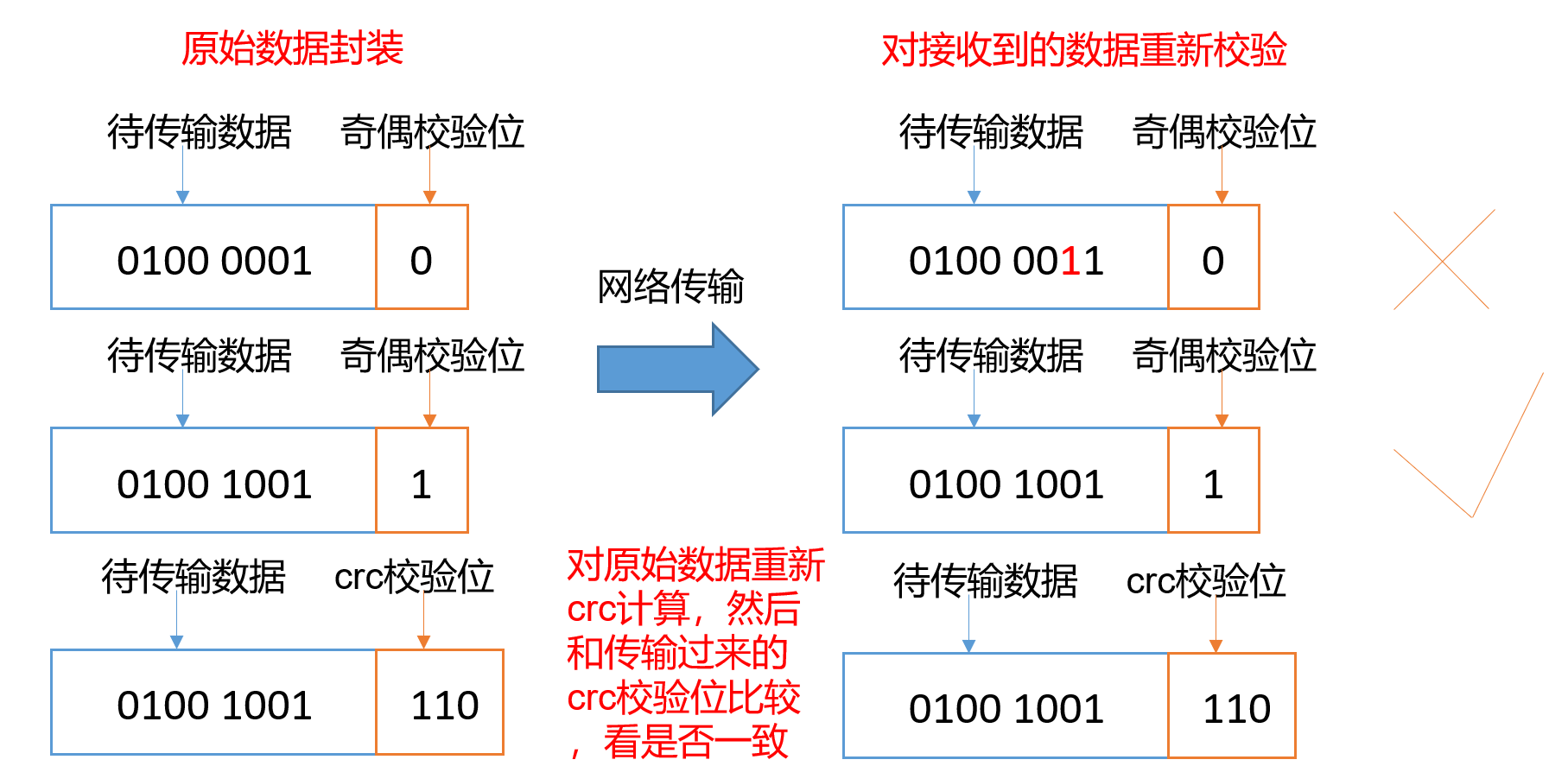

5.2、 数据完整性

思考:如果电脑磁盘里面存储的数据是控制高铁信号灯的红灯信号(1)和绿灯信号(0),但是存储该数据的磁盘坏了,一直显示是绿灯,是否很危险?同理DataNode节点上的数据损坏了,却没有发现,是否也很危险,那么如何解决呢?

如下是DataNode节点保证数据完整性的方法。

(1)当DataNode读取Block的时候,它会计算CheckSum。

(2)如果计算后的CheckSum,与Block创建时值不一样,说明Block已经损坏。

(3)Client读取其他DataNode上的Block。

(4)常见的校验算法crc(32),md5(128),sha1(160)

(5)DataNode在其文件创建后周期验证CheckSum。

5.3、 掉线时限参数设置

需要注意的是hdfs-site.xml 配置文件中的heartbeat.recheck.interval的单位为毫秒,dfs.heartbeat.interval的单位为秒

dfs.namenode.heartbeat.recheck-interval 300000

dfs.heartbeat.interval 3